11į┬15╚šŽ¹ŽóŻ¼░ó└’įŲā╔╠ņŪ░ķ_į┤Ą─═©┴x┤·┤a─Żą═Qwen2.5-CoderŻ¼į┌Big Code ModelsĪóSAFIMĪóEvalPlusĪóBigCodeBenchĪóAiderĪóTabbyMLĄ╚┴∙┤¾ÖÓ═■░±å╬╔Ž╚ĪĄ├┴╦ķ_į┤ūŅ╝č│╔┐āŻ¼ūŅÅŖķ_į┤┤·┤a┤¾─Żą═į┘┤╬Ą├ĄĮėĪūCĪŻō■┴╦ĮŌŻ¼Qwen2.5-Coder╩▄╚½Ū“ķ_░lš▀¤ß┼§Ż¼ķ_į┤āHāH2╠ņŻ¼─Żą═Ž┬▌d┴┐╝┤═╗ŲŲ25╚fŻ¼ĄŪ╔ŽHugging Face┌ģä▌░±░±╩ū╝░Github┌ģä▌░±å╬ĪŻ

Qwen2.5-Coder╣▓ķ_į┤6éĆų„┴„─Żą═│▀┤ńŻ¼░³║¼0.5BĪó1.5BĪó3BĪó7BĪó14BĪó32BĄ╚░µ▒ŠŻ¼├┐éĆ│▀┤ńČ╝ķ_į┤┴╦Base║═Instruct─Żą═Ż¼╦∙ėą░µ▒Š─Żą═Č╝╚ĪĄ├┴╦═¼│▀┤ńŽ┬Ą─śIĮńūŅ╝čąį─▄ą¦╣¹ĪŻ

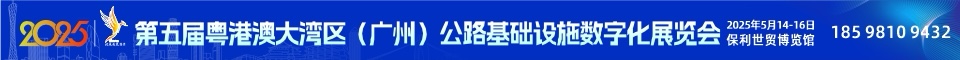

į┌╚½├µ┐╝▓ņ─Żą═Ą─┤·┤a╔·│╔─▄┴”Ą─EvalPlus░±å╬╔ŽŻ¼Qwen2.5-Coder-32B-Instruct─Żą═─├Ž┬ķ_į┤Ą┌ę╗├¹Ż╗į┌įu╣└Å═ļsŠÄ│╠╚╬äš─▄┴”Ą─BigCodeBench┼┼ąą░±╔ŽŻ¼32B-Instruct─Żą═╦óą┬ķ_į┤─Żą═ūŅ╝č│╔┐āŻ╗į┌┐╝▓ņ┤·┤aą▐Å═─▄┴”Ą─Aider┤¾─Żą═░±å╬ųąŻ¼32B-Instruct─Żą═öł½@ķ_į┤╣┌▄ŖĪŻ

Qwen2.5-Coder-32B-Instruct─├Ž┬EvalPlus░±å╬╔Žķ_į┤Ą┌ę╗├¹

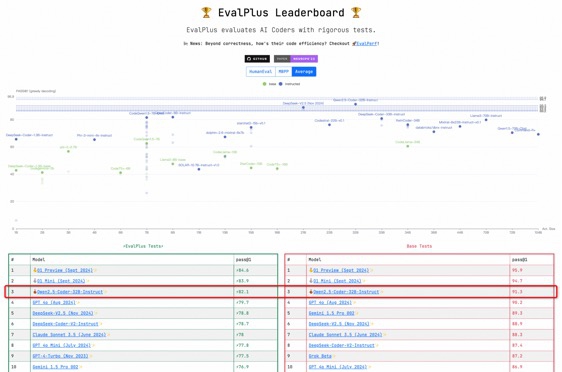

į┌╚½Ū“ų„┴„AI┤¾─Żą═ķ_į┤╔ńģ^Hugging FaceĄ─Big Code Models Leaderboard░±╔ŽŻ¼═©┴xķ_į┤┤·┤a─Żą═į┌Ū░╬Õ├¹└’š╝ō■╚²Ž»Ż¼32B-Instruct─Żą═┼┼├¹Ą┌ę╗Ż¼32B-Base─Żą═┼┼├¹Ą┌Č■Ż╗32B-Base─Żą═▀Ć─├Ž┬šZĘ©Ėąų¬╠Ņ┐šŻ©SAFIMŻ®┼┼ąą░±┐é░±╣┌▄ŖŻ¼Ųõ┤·┤aą▐Å═╝░ča╚½─▄┴”▒╗šJ×ķ╩Ūķ_į┤ķ]į┤╦∙ėą─Żą═Ą─ūŅ╝čĪŻ┤╦═ŌŻ¼į┌┐╝▓ņ20BęÄ─ŻęįŽ┬─Żą═Ą─TabbyML░±å╬ųąŻ¼Qwen2.5-Coder-14B╚ĪĄ├┴╦╦∙ėą─Żą═Ą─Ą┌ę╗ĪŻ

Hugging FaceĄ─Big Code Models Leaderboard┐é░±╣┌▄ŖŻ¼Top5└’═©┴xš╝ō■3Ž»

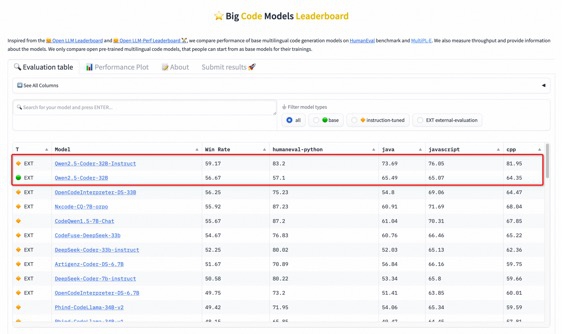

Ė”ę╗░l▓╝Ż¼Qwen2.5-CoderŠ═ę²▒¼┴╦╚½Ū“ķ_į┤╔ńģ^Ż¼32B-Instrcut─Żą═ų▒ĮėĄŪĒöHugging Face╔ńģ^┌ģä▌░±å╬╣┌▄ŖŻ¼▓óĄŪ╔ŽGithub┌ģä▌░±å╬Ż¼GitHub StaröĄų▒ŠĆ’j╔²ĮėĮ³2000ĪŻō■▓╗═Ļ╚½ĮyėŗŻ¼ķ_į┤āHā╔╚šŻ¼Qwen2.5-CoderŽĄ┴ą─Żą═į┌─¦┤Ņ╔ńģ^ModelScopeĪóHugging FaceĪóOllamaĄ╚ŲĮ┼_Ž┬▌d┴┐═╗ŲŲ25╚f┤╬Ż¼äōįņ┴╦īŻśI─Żą═ķ_į┤Ą─╚½Ū“ą┬╝oõøĪŻ

Qwen2.5-Coder-32B-Instrcut─Żą═ĄŪĒöHugging Face╔ńģ^┌ģä▌░±å╬

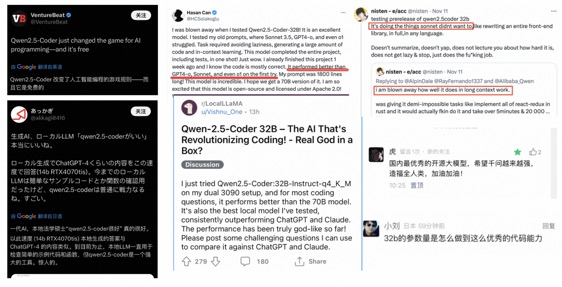

ķ_į┤╔ńģ^ķ_░lš▀éāī”Qwen2.5-Coder╚½ŽĄ┴ąķ_į┤┘Ø▓╗Į^┐┌Ż¼╦¹éāį┌Ė„┤¾ŲĮ┼_╔Ž█x▄SĘųŽĒę╗╩ų¾w“×║═Ėą╩▄Ż¼ĘQ┘Ø32B-Instruct“╔±╝ē▒Ē¼F”Ż¼“ą¦╣¹▒╚GPT-4oĪóClaude Sonnet╔§ų┴o1Č╝║├ŻĪ”Ż¼┐õ¬äQwen2.5-Coder╩Ū“Ħķ_░lĄ─╔±▒°└¹Ų„”Īó“Ė─ūā┴╦AIŠÄ│╠Ą─ė╬æ“ęÄät”ĪŻ

ķ_░lš▀įušōĮžłD